채널톡 ALF 도입 평가 보고서

데모 미팅 · 공식 문서 · 외부 리뷰를 종합한 기술/운영 관점 의사결정 자료. 기존 Zendesk 자체 CS 챗봇에서 채널톡 ALF로의 전면 전환 타당성을 재평가한다.

TL;DR

채널톡 ALF는 AI 기술 상품이 아닌 CS 운영 통합 스위트다. AI 성능(해결률·정확도·속도)은 우리 자체 LangGraph 대비 뚜렷한 우위가 없다.

차별점은 CS팀이 직접 쓰는 운영 UI, 통계 대시보드, 상담 워크플로우 통합에 있다. 따라서 의사결정 주체는 AI팀이 아닌 CS팀이어야 하며, 비교 기준도 "AI 품질"이 아닌 "운영 편의성"으로 재정의해야 한다.

- 기반 모델은 OpenAI GPT-3.5/4 래퍼. 자체 LLM 없음.

- 공식 공개 벤치마크는 Retrieval 한정 · 테스트셋 35개 · Recall@5 0.48

- 전체 고객사 평균 해결률 45% (광고 80%는 자사 체리픽)

- 데모 현장: Task 노가다 + 실행 속도 느림 + UI-only + AI 품질 의심

- 권고: 전면 전환 보류 · CS팀 실사용자 인터뷰 선행 · 하이브리드/조건부 POC 재검토

배경 · 검토 경과

1.1 전환 검토 동기

- 현재 AI팀이 Zendesk 웹훅 기반 자체 챗봇(

cs-agent)을 전담 운영 - 문서/페르소나/API/인프라/대시보드까지 모두 AI팀 부담

- CS팀 요청마다 개발 공수 · 운영 병목 발생

- "CS팀 자율 운영 + AI팀 고부가가치 집중" 구조 전환 목적

1.2 검토 경과

- 1차 미팅 — 신입 마케터 방문 · 영업 중심 · 기술 검증 불가

- 1차 서면 (Hian) — ALF 전제 수용 · 데모 요청 · 기획팀 UI 요구 4종

- 2차 서면 (채널톡) — 시나리오 추가 요청 · ALF Task 구조 소개

- 3차 서면 (Hian) — 데모 일정 · WAM 지원 · 기술 담당자 동반 요청

- 이후 무응답 (응답 주기 매회 1주, 최종 미응답)

- 2차 미팅 (2026-04-17) — 본 보고서의 현장 관찰 근거

현재 우리 시스템

2.1 구성

| 레이어 | 구성 |

|---|---|

| Lambda | ai-cs-chatbot (공통/snaps/snapsjp/stg), ai-cs-chatbot-producer |

| 큐 | SQS FIFO 브랜드별 + DLQ |

| 저장 | DynamoDB (ai-cschat-analysis, ai-chatbot-evaluation) |

| RAG | chromadb 자체 서버 |

| 관측 | Langfuse |

| 레포 | cs-agent (브랜드별 브랜치), ai-chatbot-manager, ai-chatbot-tester |

| 런타임 | Python + LangGraph |

| 진입 | Zendesk 웹훅 → Lambda → SQS → Consumer → DynamoDB |

| 브랜드 | Snaps KR / Snaps JP / 오프린트미 |

2.2 AI팀 현재 부담 영역

- FAQ 문서 시스템 개발·유지보수

- 페르소나/프롬프트 수정·배포

- API 웹훅 개발 · 장애 대응

- 서버/인프라 모니터링

- CS팀 요청 대응 (문서/말투 변경마다 개발)

- 성과 측정 대시보드 자체 구축

ALF 기술 실체

3.1 기반 모델

- OpenAI GPT-3.5 + GPT-4 조합 (채널톡 공식 기사 확인)

- 자체 LLM 없음 · 프롬프트 체이닝 + RAG 엔진이 본질

- OpenAI 정책/가격/장애에 전적으로 종속

3.2 파이프라인 구조

라우팅 → 문의 요약 → 관련 검색 → 결과 필터 → 답변 생성 → 근거 팩트체크

각 단계가 LLM 호출을 동반 → 최소 5~6회 누적 호출 → 체감 latency 저하의 구조적 원인

3.3 공개 벤치마크 (Retrieval 한정)

| 메트릭 | Vector | BM25 | Hybrid (최고) |

|---|---|---|---|

| Hit@5 | 24/35 | 21/35 | 24/35 |

| Recall@5 | 0.41 | 0.41 | 0.48 |

| nDCG@5 | 0.43 | 0.40 | 0.52 |

| Recall@20 | 0.65 | 0.56 | 0.70 |

- Top-5 문서 정답 포함률 48% (절반 이하)

- 테스트셋 35개 · 통계 신뢰도 빈약

- LLM 최종 응답 정확도 End-to-end 벤치는 미공개

- 응답 속도(p50/p95/TTFT)는 완전 비공개

3.4 해결률 스펙트럼

| 구분 | 해결률 | 비고 |

|---|---|---|

| 전체 고객사 평균 (2025-11) | 45% | 약 2,000개사 / 130만 건 |

| 채널톡 자사 (ALF v2) | 80% | 자사 CS, 최적 튜닝 전제 |

| 채널톡 자사 피크 | 85% | 추석 연휴 특정 시점 |

| 이스타항공 | 74% | 항공=단순반복 많음 |

| 베리시 | 51% | 상품 입고/세탁법 단순 정보 |

| 온누리스토어 | — | 상담사 이관용 정보 수집 |

→ 광고 80%는 체리픽. 현실 기대치는 평균 45% 수준.

미팅 현장 관찰 (2026-04-17)

4.1 데모에서 확인된 사실

- 태스크 단계 하나하나 UI로 조립 · 반복 작업 많음

- 코드 노드는 JS 필수 (공식 표현 "주니어 개발자 수준")

- 체이닝 단계 누적으로 체감 실행 속도 저하

- 외부 IDE/Git 없음 → 버전관리·코드리뷰·감사 로그 부재

- 데모 시연 AI 응답 만족스럽지 않음

4.2 현장 관찰 ↔ 공식 자료 교차 검증

| 현장 관찰 | 공식/외부 자료 근거 |

|---|---|

| 태스크 노가다 + 개발자 필요 | 공식 "주니어 개발자 수준이면 구현 가능" + G2 "learning curve" |

| 실행 속도 느림 | 체이닝 5~6단계 구조 + 공식 "모든 내역 확인 시 느려질 수 있음" 시인 |

| UI-only, JSON export만 | G2 "integration 제한" |

| AI 품질 의심 | Retrieval Recall@5 0.48 + 전체 평균 해결률 45% |

외부 평가 자료

5.1 G2 / Research.com 공통 단점

- 가격 — 무료 이후 스타트업/에이전시 기준 가파른 상승

- 고객 지원 제한적

- 엔터프라이즈 기능 부족 — Zendesk 대비 중대형 고객 대응 약함

- 학습 곡선 · 통합(Integration) 선택지 제한

5.2 과금 구조 (2025-11-28 개편)

- 상담 1건당 ALF 과금 (최초 답변 ~ 종료)

- Growth 플랜 월 3만원 상당 기본 제공

- 초과분 건당 과금 → 3개 브랜드 볼륨에서 비용 급증 가능

5.3 개인 후기 풀의 얕음

- 공식/PR 기사만 풍부

- Brunch, Disquiet, 개발자 블로그 등 독립 후기 거의 없음

- 비판적 후기 및 latency/장애 리포트 공개 자료 전무

- 시그널 — 실제 사용자 피드백 기반이 아직 얇은 단계

차별점 재정의 — ALF의 진짜 가치

6.1 AI 엔진으로서 평가

| 항목 | 평가 | 근거 |

|---|---|---|

| 기반 모델 | GPT-4 래퍼 | 자체 LLM 없음 |

| Retrieval 품질 | 중간~낮음 | Recall@5 0.48 |

| 응답 속도 | 느림 | 체이닝 5~6단계 |

| 해결률 실측 평균 | 45% | 공식 통계 |

| 할루시네이션 방지 | 팩트체크 모듈 있음 | 세부 수치 미공개 |

→ AI 기술만 놓고 보면 우리 자체 LangGraph 대비 우위 없음. 오히려 GPT-4를 직접 쓰며 프롬프트를 우리가 제어하는 게 더 나은 측면 존재.

6.2 실제 차별점 (= 진짜 가치)

| 영역 | 차별 가치 |

|---|---|

| CS팀 운영 UI | 노션형 문서 에디터 · Rules 메뉴 · 태스크 단계 조립 |

| 상담 플랫폼 통합 | 채팅 + CRM + 마케팅 + 통계 한 화면 |

| 기본 대시보드 | 참여율/해결률/CSAT 즉시 제공 |

| 다국어 자동 감지 | 33개 언어 (Snaps JP 관련) |

| 인프라 책임 이관 | 채널톡 측 AWS + ISMS/ISO |

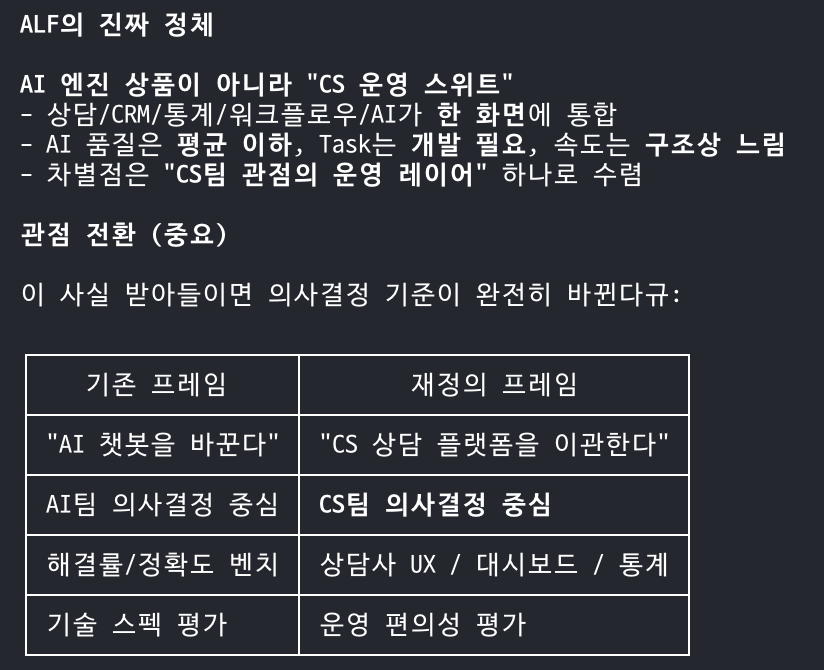

6.3 관점 전환

| 기존 프레임 | 재정의 프레임 |

|---|---|

| AI 챗봇 교체 | CS 상담 플랫폼 이관 |

| AI팀 의사결정 | CS팀 의사결정 |

| 해결률/정확도 비교 | 상담사 UX / 대시보드 / 통계 비교 |

| 기술 스펙 평가 | 운영 편의성 평가 |

“우리가 사는 것은 AI가 아니라, CS 운영 UI와 통계 레이어다.”

이 전제 하에 ROI를 다시 계산해야 한다. AI팀이 절감할 거라던 공수는 실제로는 Task 개발로 그대로 유지될 가능성이 높다.

리스크

| 영역 | 리스크 |

|---|---|

| 품질 | 해결률 실제 평균 45%, 복잡 문의(편집기·주문 커스텀·다국어) 기대 이하 가능 |

| 속도 | 체이닝 구조상 느림 → 고객 체감 저하 |

| 개발 공수 | Task = JS 코드 노드 필수, AI팀 공수 절감 명분 흔들림 |

| 운영 | UI-only → 코드리뷰/버전관리/감사 부재 |

| 비용 | 건당 과금 + 3개 브랜드 볼륨, 월 비용 예측 불확실 |

| 락인 | Task 로직·문서·대화 이력 모두 채널톡 내부, 이관 시 손실 큼 |

| OpenAI 종속 | GPT 가격/정책/장애가 ALF에 직접 전이 |

| 보안 | 데이터 리전/개인정보 취급 세부 검증 필요 |

| 마이그레이션 | Zendesk 대화 이력 이관 도구 미검증 |

| 벤더 응답성 | 이메일 응답 1주일+, 최종 무응답 — 장애 대응 속도 우려 |

의사결정 옵션

권고 사항

9.1 즉시 보류해야 할 결정

- ALF 전면 전환 확정 보류

- 기획팀이 CS팀·경영진에 공유한 "전환 기정사실" 메시지 수정 필요

9.2 30일 내 수행 과제

- CS팀 실사용자 인터뷰 (최소 5명, 브랜드별)

- 현재 Zendesk에서 불편한 지점 구체화

- ALF UI/대시보드가 그 문제를 실제 해결하는지 검증

- 상담사가 원하는 지표/워크플로우 명세화

- 하이브리드 가능성 타진 — 채널톡 상담 플랫폼 + 자체 AI 엔진 연동 서면 확인

- POC 제안서 요청 — §8-C의 합격 기준 포함한 정식 POC 스코프

- 자체 시스템 CS 셀프서비스 레이어 설계 — §8-D 대비책, 1주 내 프로토타입

9.3 미팅장 종결 시 합의 사항

- 서면 답변 기한 3영업일 못 박기

- 기술 담당자 직접 Q&A 채널 개설 (Slack/이메일)

- 다음 미팅 일정 고정

서면 답변 요청 목록

- 기반 LLM — GPT-4 외 자체 파인튜닝/디스틸 모델 존재?

- LLM End-to-end 응답 정확도 벤치마크 수치

- p50 / p95 / TTFT latency 공식 수치

- "해결률"의 정의 (자동응답/이관/포기 분류 기준)

- 우리 기준(3브랜드 · 월 N건) 월 비용 견적

- Task를 외부 Git/CI/코드리뷰와 연동 가능한가

- Task 버전 이력 / 롤백 / 감사 로그 제공 범위

- 우리 규모·복잡도 유사 레퍼런스 3곳

- ALF 우회 외부 AI 엔진 연동 가능성 (하이브리드)

- OpenAI API 장애/가격 인상 시 보상·대응 정책

- 데이터 저장 리전, 개인정보 취급, ISMS 범위 문서

- Zendesk 대화 이력 이관 도구·방법

결론

채널톡 ALF의 기술적 우위는 한정적이며, 실질 가치는 CS 운영 UI와 통계 플랫폼에 있다. 우리의 의사결정은 따라서 AI 관점이 아닌 CS팀 관점에서 재평가되어야 한다.

현 시점 권고

- 전면 전환 보류

- CS팀 실사용자 인터뷰 수행

- 하이브리드 / 조건부 POC 가능성 검증

- 자체 시스템 CS 셀프서비스 레이어 병행 설계

최종 판단은 CS팀 인터뷰 결과와 POC 합격 기준 충족 여부를 근거로 내려야 한다.